Qualsiasi completamento chat Mcp Server Mcp

MCP Server per utilizzare qualsiasi LLM come strumento

Panoramica

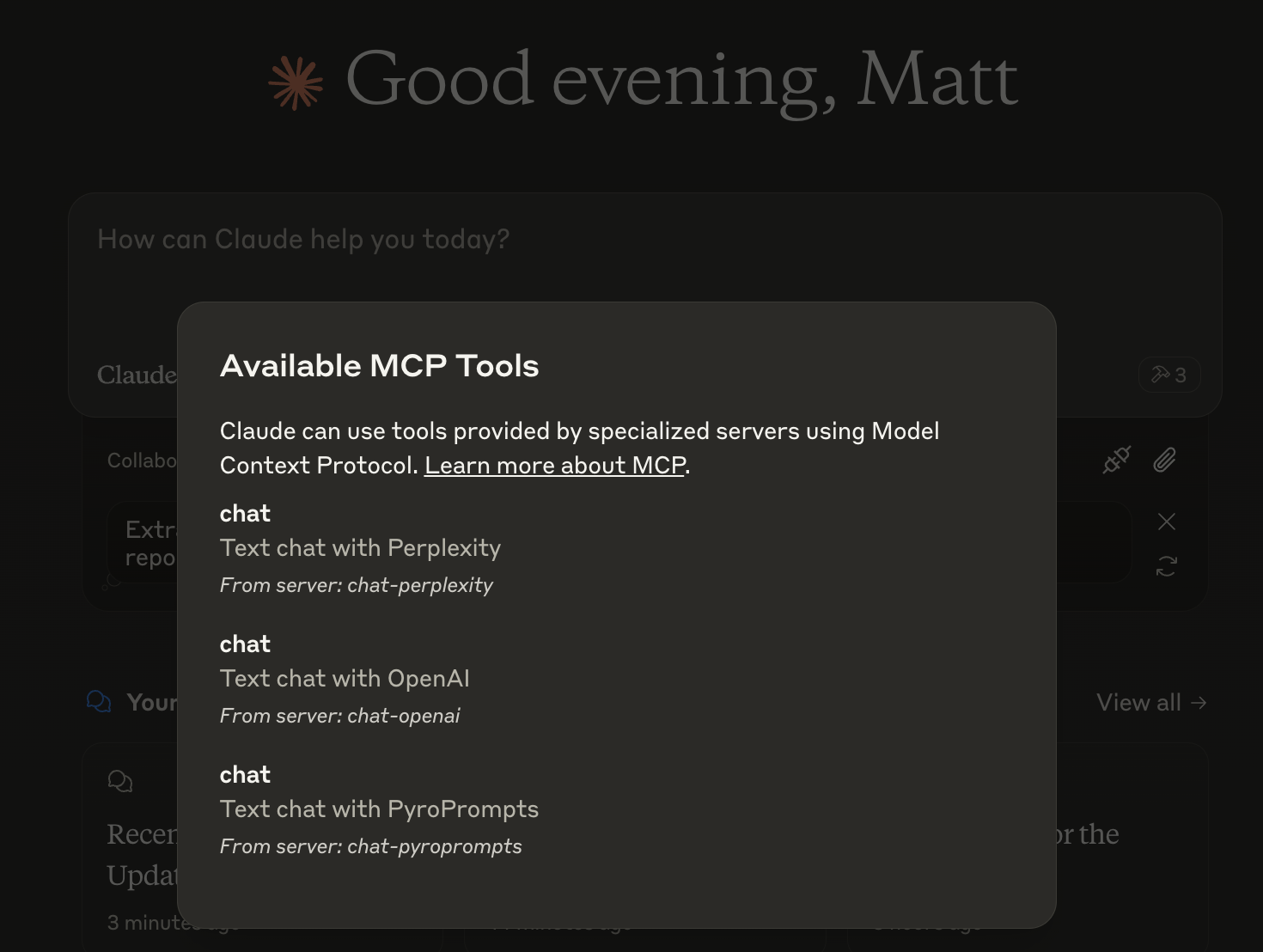

Cos'è Any Chat Completions MCP?

Any Chat Completions MCP è un server versatile progettato per utilizzare qualsiasi Modello di Linguaggio di Grandi Dimensioni (LLM) come strumento. Questa piattaforma innovativa consente a sviluppatori e utenti di integrare vari LLM nelle loro applicazioni, migliorando le capacità di chatbot e altre interfacce conversazionali. Sfruttando la potenza degli LLM, gli utenti possono creare interazioni più coinvolgenti e intelligenti, rendendolo una risorsa preziosa per aziende e sviluppatori.

Caratteristiche di Any Chat Completions MCP

- Supporto Multi-LLM: Il server supporta più LLM, consentendo agli utenti di scegliere il modello migliore per le loro esigenze specifiche.

- Integrazione Facile: Con un'API semplice, gli sviluppatori possono facilmente integrare il server nelle loro applicazioni esistenti.

- Scalabilità: L'architettura è progettata per gestire un gran numero di richieste, rendendola adatta sia per piccoli progetti che per applicazioni su larga scala.

- Personalizzabile: Gli utenti possono personalizzare il comportamento degli LLM per adattarsi ai loro casi d'uso specifici, migliorando l'esperienza utente.

- Open Source: Essendo un progetto open-source, incoraggia i contributi della comunità e la trasparenza.

Come Utilizzare Any Chat Completions MCP

- Installazione: Inizia clonando il repository da GitHub e installando le dipendenze necessarie.

- Configurazione: Configura il tuo ambiente impostando le impostazioni del server per specificare quali LLM desideri utilizzare.

- Integrazione API: Usa gli endpoint API forniti per inviare richieste al server e ricevere risposte dagli LLM.

- Test: Testa l'integrazione in un ambiente di sviluppo per assicurarti che tutto funzioni come previsto.

- Distribuzione: Una volta testato, distribuisci il server nel tuo ambiente di produzione e inizia a utilizzare gli LLM nelle tue applicazioni.

Domande Frequenti

D: Qual è il caso d'uso principale per Any Chat Completions MCP?

R: Il caso d'uso principale è migliorare i chatbot e le interfacce conversazionali integrando vari LLM, consentendo interazioni più intelligenti e coinvolgenti.

D: Any Chat Completions MCP è gratuito da usare?

R: Sì, è un progetto open-source, il che significa che è gratuito da usare e modificare.

D: Posso contribuire al progetto?

R: Assolutamente! I contributi sono benvenuti. Puoi inviare segnalazioni di problemi, richieste di funzionalità o pull request sul repository GitHub.

D: Quali linguaggi di programmazione sono supportati?

R: Il server è progettato per essere indipendente dal linguaggio, ma l'API può essere facilmente accessibile utilizzando linguaggi di programmazione popolari come Python, JavaScript e Java.

D: Come posso segnalare problemi o bug?

R: Puoi segnalare problemi o bug creando un'issue sul repository GitHub, fornendo dettagli sul problema riscontrato.

Utilizzando Any Chat Completions MCP, gli sviluppatori possono migliorare significativamente le capacità conversazionali delle loro applicazioni, rendendolo uno strumento potente nel campo dell'IA e dell'apprendimento automatico.

Dettaglio

Configurazione Server

{

"mcpServers": {

"any-chat-completions-mcp": {

"command": "docker",

"args": [

"run",

"-i",

"--rm",

"ghcr.io/metorial/mcp-container--pyroprompts--any-chat-completions-mcp--any-chat-completions-mcp",

"npm run start"

],

"env": {

"AI_CHAT_KEY": "ai-chat-key",

"AI_CHAT_NAME": "ai-chat-name",

"AI_CHAT_MODEL": "ai-chat-model",

"AI_CHAT_BASE_URL": "ai-chat-base-url"

}

}

}

}