कोई चैट पूर्णता MCP MCP सर्वर

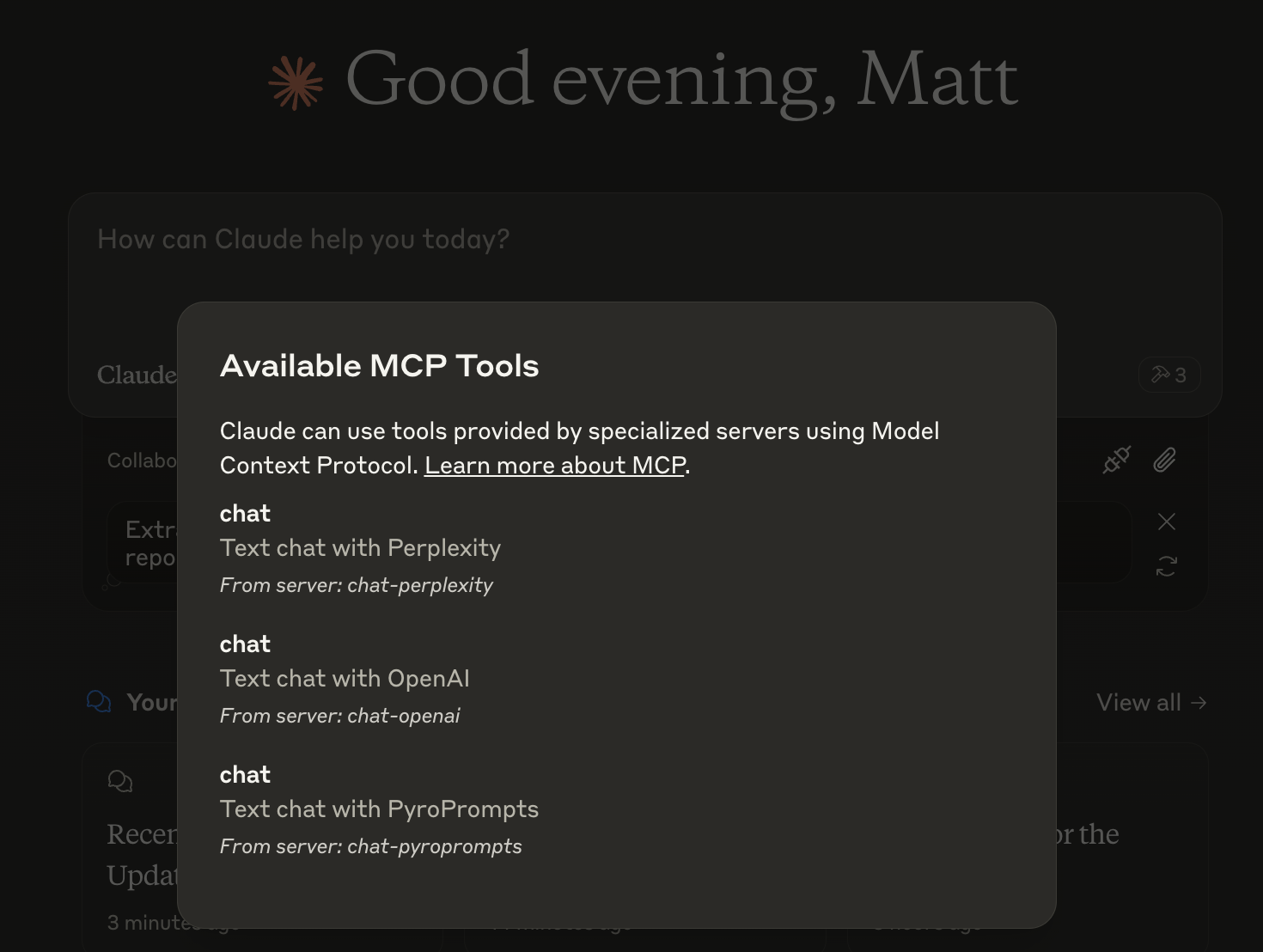

MCP सर्वर का उपयोग किसी भी LLM को एक उपकरण के रूप में करने के लिए

सारांश

Any Chat Completions MCP क्या है?

Any Chat Completions MCP एक बहुपरकारी सर्वर है जिसे किसी भी बड़े भाषा मॉडल (LLM) को एक उपकरण के रूप में उपयोग करने के लिए डिज़ाइन किया गया है। यह नवोन्मेषी प्लेटफ़ॉर्म डेवलपर्स और उपयोगकर्ताओं को विभिन्न LLMs को उनके अनुप्रयोगों में एकीकृत करने की अनुमति देता है, जिससे चैटबॉट और अन्य संवादात्मक इंटरफेस की क्षमताओं में सुधार होता है। LLMs की शक्ति का लाभ उठाकर, उपयोगकर्ता अधिक आकर्षक और बुद्धिमान इंटरैक्शन बना सकते हैं, जिससे यह व्यवसायों और डेवलपर्स के लिए एक मूल्यवान संसाधन बन जाता है।

Any Chat Completions MCP की विशेषताएँ

- मल्टी-LLM समर्थन: सर्वर कई LLMs का समर्थन करता है, जिससे उपयोगकर्ता अपनी विशिष्ट आवश्यकताओं के लिए सबसे अच्छे मॉडल का चयन कर सकते हैं।

- आसान एकीकरण: एक सरल API के साथ, डेवलपर्स आसानी से सर्वर को अपने मौजूदा अनुप्रयोगों में एकीकृत कर सकते हैं।

- स्केलेबिलिटी: आर्किटेक्चर को बड़ी संख्या में अनुरोधों को संभालने के लिए डिज़ाइन किया गया है, जिससे यह छोटे प्रोजेक्ट्स और बड़े पैमाने पर अनुप्रयोगों के लिए उपयुक्त है।

- अनुकूलन योग्य: उपयोगकर्ता LLMs के व्यवहार को अपनी विशिष्ट उपयोग के मामलों के अनुसार अनुकूलित कर सकते हैं, जिससे उपयोगकर्ता अनुभव में सुधार होता है।

- ओपन सोर्स: एक ओपन-सोर्स प्रोजेक्ट होने के नाते, यह सामुदायिक योगदान और पारदर्शिता को प्रोत्साहित करता है।

Any Chat Completions MCP का उपयोग कैसे करें

- स्थापना: GitHub से रिपॉजिटरी को क्लोन करके और आवश्यक निर्भरताएँ स्थापित करके शुरू करें।

- कॉन्फ़िगरेशन: सर्वर सेटिंग्स को कॉन्फ़िगर करके अपने वातावरण को सेट करें ताकि आप यह निर्दिष्ट कर सकें कि आप कौन से LLMs का उपयोग करना चाहते हैं।

- API एकीकरण: सर्वर को अनुरोध भेजने और LLMs से प्रतिक्रियाएँ प्राप्त करने के लिए प्रदान किए गए API एंडपॉइंट्स का उपयोग करें।

- परीक्षण: यह सुनिश्चित करने के लिए विकास वातावरण में एकीकरण का परीक्षण करें कि सब कुछ अपेक्षित रूप से कार्य कर रहा है।

- तैनाती: एक बार परीक्षण हो जाने के बाद, सर्वर को अपने उत्पादन वातावरण में तैनात करें और अपने अनुप्रयोगों में LLMs का उपयोग करना शुरू करें।

अक्सर पूछे जाने वाले प्रश्न

प्रश्न: Any Chat Completions MCP का प्राथमिक उपयोग मामला क्या है?

उत्तर: प्राथमिक उपयोग मामला विभिन्न LLMs को एकीकृत करके चैटबॉट और संवादात्मक इंटरफेस को बेहतर बनाना है, जिससे अधिक बुद्धिमान और आकर्षक इंटरैक्शन संभव हो सके।

प्रश्न: क्या Any Chat Completions MCP का उपयोग मुफ्त है?

उत्तर: हाँ, यह एक ओपन-सोर्स प्रोजेक्ट है, जिसका अर्थ है कि इसका उपयोग और संशोधन मुफ्त है।

प्रश्न: क्या मैं प्रोजेक्ट में योगदान कर सकता हूँ?

उत्तर: बिल्कुल! योगदान का स्वागत है। आप GitHub रिपॉजिटरी पर मुद्दे, फीचर अनुरोध, या पुल अनुरोध सबमिट कर सकते हैं।

प्रश्न: कौन से प्रोग्रामिंग भाषाएँ समर्थित हैं?

उत्तर: सर्वर को भाषा-निष्पक्ष रूप से डिज़ाइन किया गया है, लेकिन API को लोकप्रिय प्रोग्रामिंग भाषाओं जैसे Python, JavaScript, और Java का उपयोग करके आसानी से एक्सेस किया जा सकता है।

प्रश्न: मैं मुद्दों या बग्स की रिपोर्ट कैसे करूँ?

उत्तर: आप GitHub रिपॉजिटरी पर एक मुद्दा बनाकर समस्याओं या बग्स की रिपोर्ट कर सकते हैं, जिसमें आप द्वारा सामना की गई समस्या के बारे में विवरण प्रदान करें।

Any Chat Completions MCP का उपयोग करके, डेवलपर्स अपने अनुप्रयोगों की संवादात्मक क्षमताओं को महत्वपूर्ण रूप से बढ़ा सकते हैं, जिससे यह AI और मशीन लर्निंग के क्षेत्र में एक शक्तिशाली उपकरण बन जाता है।

विवरण

सर्वर कॉन्फ़िगरेशन

{

"mcpServers": {

"any-chat-completions-mcp": {

"command": "docker",

"args": [

"run",

"-i",

"--rm",

"ghcr.io/metorial/mcp-container--pyroprompts--any-chat-completions-mcp--any-chat-completions-mcp",

"npm run start"

],

"env": {

"AI_CHAT_KEY": "ai-chat-key",

"AI_CHAT_NAME": "ai-chat-name",

"AI_CHAT_MODEL": "ai-chat-model",

"AI_CHAT_BASE_URL": "ai-chat-base-url"

}

}

}

}